La Nueva Era de la IA Conectada

La inteligencia artificial ha avanzado a pasos agigantados, especialmente con la irrupción de los Modelos de Lenguaje Grandes (LLM). Estas potentes herramientas han demostrado una capacidad asombrosa para generar texto coherente, razonar y responder a una vasta gama de preguntas. Sin embargo, su conocimiento se limita inherentemente a los datos con los que fueron entrenados. Para que la IA trascienda la mera conversación y se convierta en una entidad verdaderamente «agéntica» —es decir, capaz de seguir objetivos y actuar de forma autónoma en el mundo real—, necesita urgentemente una forma estandarizada de interactuar con información en tiempo real y herramientas externas. La visión de una IA que no solo «habla» sino que «hace» exige un puente robusto y uniforme hacia el vasto ecosistema digital y físico.

Aquí es donde entra en juego el Protocolo de Contexto de Modelo (MCP), o Model Context Protocol. Este estándar abierto y de código abierto fue presentado por Anthropic, Microsoft, y Google en marzo de 2024 y, de manera notable, se lanzó como código abierto a principios de junio del mismo año. Su propósito fundamental es unificar la forma en que los sistemas de IA, incluidos los LLM y los agentes de IA, descubren, recuperan y contextualizan datos desde integraciones y servidores externos conectados. La rápida evolución de MCP, desde su presentación inicial hasta convertirse en un estándar de la industria en cuestión de meses, subraya la urgencia y la necesidad crítica de un protocolo de este tipo dentro de la comunidad de IA. Esta celeridad en la estandarización no solo refleja la visión de Anthropic, sino que también representa una respuesta directa a la demanda del ecosistema por una interoperabilidad fluida. La agilidad con la que este protocolo ha sido adoptado demuestra la madurez del sector de la IA para identificar y abordar los cuellos de botella en la integración.

La visión del MCP es ambiciosa: ser un «puerto universal» para la IA agéntica. Se puede concebir el MCP como un «puerto USB-C para agentes de IA« o un «control remoto universal para aplicaciones de IA«. Su diseño elimina la necesidad de configuraciones manuales complejas y de integraciones personalizadas para cada herramienta o fuente de datos. Por ejemplo, en lugar de que una empresa de comercio electrónico tenga que desarrollar una integración API separada para cada proveedor de pago (como Stripe, PayPal o Amazon Pay), el MCP ofrece un único punto de integración que puede conectarse con cualquier servicio de pago que tenga un servidor MCP. En esencia, permite que los programas de IA superen las limitaciones de su entrenamiento inicial, incorporando nuevas fuentes de información en su proceso de toma de decisiones y generación de contenido, y conectándose a herramientas externas para realizar acciones autónomas y significativas.

¿Por Qué el MCP es Crucial Ahora? Superando las Limitaciones Tradicionales

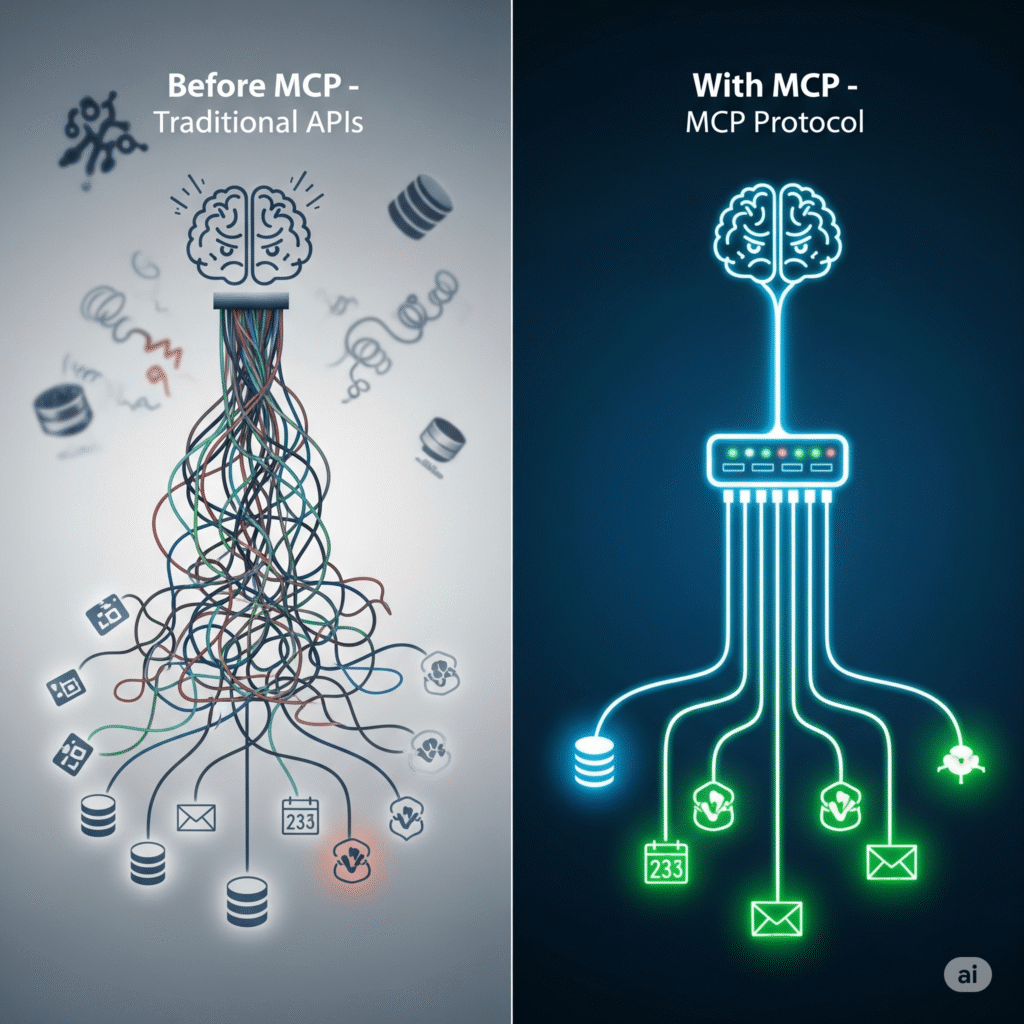

El camino hacia una inteligencia artificial verdaderamente funcional y autónoma ha estado plagado de desafíos. Tradicionalmente, los LLM operan con un conocimiento «estático», derivado exclusivamente de los datos con los que fueron entrenados. Esta limitación restringe severamente su capacidad para interactuar con información en tiempo real o para realizar acciones concretas en el mundo exterior. Conectar la IA a fuentes de datos externas y herramientas ha sido un obstáculo persistente, a menudo requiriendo integraciones API personalizadas para cada servicio. Este enfoque fragmentado implicaba la necesidad de desarrollar una lógica de autenticación separada, un manejo de errores específico y una configuración manual intensiva para cada nueva herramienta o servicio que se deseaba integrar.

La capacidad de los programas de IA para «superar su entrenamiento« es un concepto central y transformador que el MCP facilita. Mientras los LLM se encontraban confinados a sus datos de entrenamiento, ahora pueden adaptarse y evolucionar en tiempo real. Esto representa un cambio de paradigma fundamental, pasando de una IA meramente reactiva a una que es proactiva y dinámica. La complejidad inherente de las API tradicionales frenaba esta evolución, haciendo que cada nueva funcionalidad fuera un proyecto de integración oneroso. El MCP, al ofrecer una solución estandarizada, no es solo una mejora técnica; es un catalizador para una nueva generación de aplicaciones de IA que pueden operar de manera más autónoma y efectiva en entornos dinámicos, abriendo la puerta a casos de uso mucho más complejos y valiosos.

El MCP simplifica drásticamente la conexión de la IA con herramientas y datos externos. Lo logra estandarizando el proceso de integración: define una forma consistente de especificar herramientas (funciones), proporciona un protocolo para descubrir y ejecutar estas herramientas, y crea un formato universal «plug-and-play» que permite a cualquier aplicación de IA utilizar cualquier herramienta sin necesidad de código de integración personalizado. Este enfoque unificado reduce significativamente la complejidad del desarrollo y acelera el despliegue de nuevas funcionalidades de IA, lo que se traduce en una mayor compatibilidad y una implementación más sencilla.

Para ilustrar mejor las diferencias, la siguiente tabla compara el Protocolo MCP con los métodos de integración tradicionales basados en API:

| Característica | Protocolo MCP | APIs Tradicionales |

| Método de Integración | Protocolo único para todas las herramientas | Integración personalizada por cada servicio |

| Estilo de Comunicación | En tiempo real, bidireccional | Generalmente solo solicitud-respuesta |

| Descubrimiento de Herramientas | Automático y dinámico | Configuración manual |

| Conciencia del Contexto | Manejo de contexto incorporado | Soporte de contexto limitado o nulo |

| Escalabilidad | Expansión «plug-and-play» | Esfuerzo de integración lineal |

Anatomía del MCP: Arquitectura, Componentes y Flujo de Trabajo

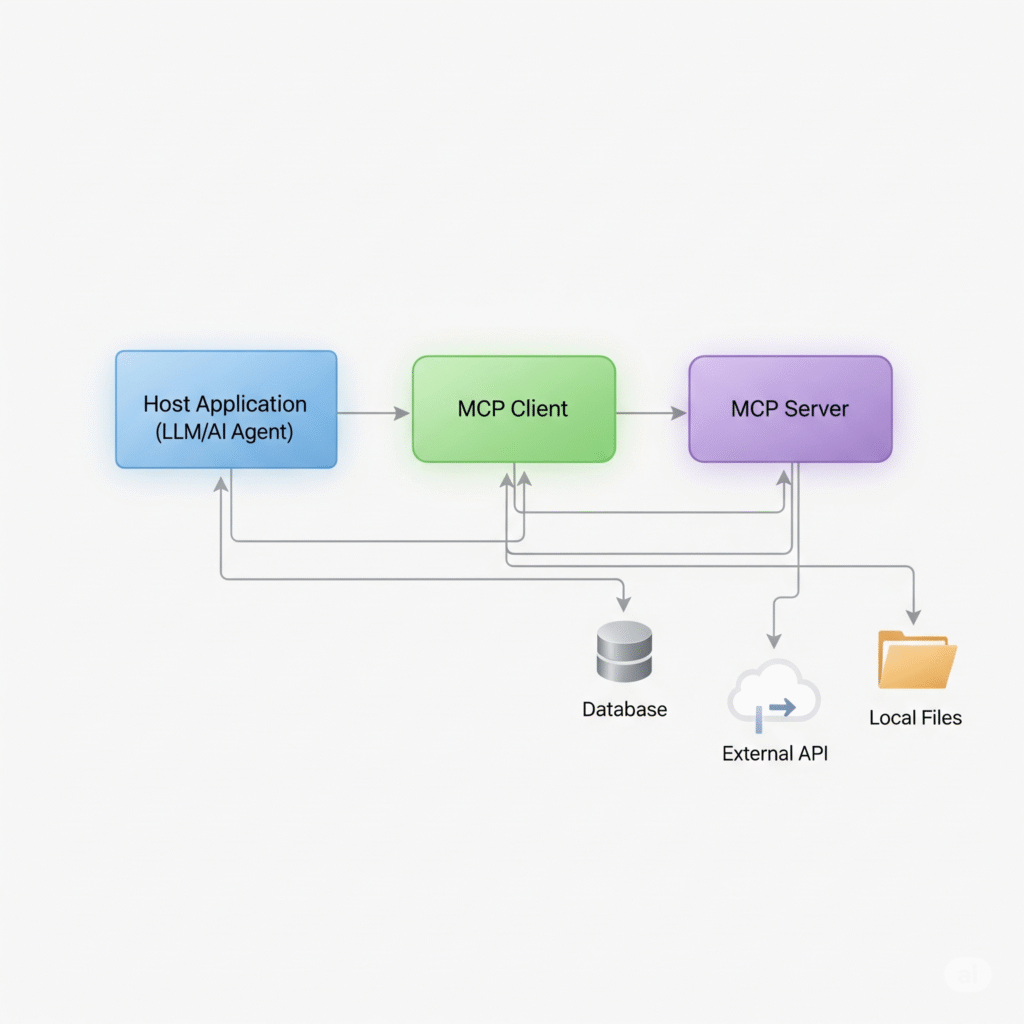

El Protocolo de Contexto de Modelo opera bajo una arquitectura cliente-servidor, un modelo que ha demostrado su robustez en diversos campos de la informática. Esta arquitectura está parcialmente inspirada en el Protocolo de Servidor de Lenguaje (LSP) (por sus siglas en inglés, Language Server Protocol), que revolucionó la forma en que los editores de código y los servidores de lenguaje se comunicaban, estandarizando las interacciones y permitiendo una mayor interoperabilidad. Al adoptar un modelo similar, el MCP busca replicar este éxito en el ámbito de la IA, creando un ecosistema de herramientas interoperables que pueden ser utilizadas por cualquier agente de IA. Esta elección de diseño es crucial porque no solo acelera el desarrollo del propio MCP, sino que también fomenta la confianza en su viabilidad a largo plazo como un estándar industrial, permitiendo a los desarrolladores centrarse en la lógica de negocio de la IA en lugar de en las complejidades de la integración.

Los componentes principales que dan vida a la arquitectura del MCP son:

- Hosts de MCP: Son las aplicaciones que actúan como la interfaz principal para el usuario y que utilizan el agente de IA. Su función es interactuar con los usuarios e iniciar las conexiones con los servidores MCP. Ejemplos comunes incluyen aplicaciones de chat de IA como Claude Desktop, entornos de desarrollo integrados (IDEs) mejorados con IA como Cursor, y las interfaces de chat web estándar de los LLM.

- Clientes de MCP: Estos componentes están integrados dentro de la aplicación host y son los encargados de gestionar las conexiones con los servidores MCP. Actúan como traductores, mediando entre los requisitos específicos del host y el protocolo MCP, y manteniendo conexiones dedicadas y uno a uno con los servidores.

- Servidores MCP: Son servidores ligeros que añaden contexto y capacidades específicas a las aplicaciones de IA. Exponen funcionalidades concretas a través del MCP, y cada servidor suele centrarse en un punto de integración particular, como una base de datos PostgreSQL para operaciones de datos o GitHub para acceso a repositorios.

La comunicación entre clientes y servidores MCP se realiza a través de una capa de transporte que soporta dos métodos principales:

- STDIO (Standard Input/Output): Se utiliza principalmente para integraciones locales, donde el servidor se ejecuta en el mismo entorno que el cliente.

- HTTP+SSE (Server-Sent Events): Empleado para conexiones remotas, donde HTTP maneja las solicitudes del cliente y SSE gestiona las respuestas y el streaming de datos desde el servidor.

Es importante destacar que toda la comunicación dentro del MCP utiliza JSON-RPC 2.0 como estándar de mensajes subyacente, lo que garantiza una estructura uniforme y predecible para solicitudes, respuestas y notificaciones.

El MCP define cuatro tipos de mensajes clave para facilitar esta comunicación:

- Solicitudes: Enviadas por el cliente al servidor MCP para pedir información o solicitar una acción.

- Resultados: La respuesta del servidor MCP con la información deseada o la confirmación de una acción.

- Errores: Mensajes enviados cuando el servidor no puede procesar una solicitud o se produce un problema.

- Notificaciones: Mensajes unidireccionales que no requieren una respuesta, enviados tanto por el cliente como por el servidor (similar a un anuncio de servicio público).

Las conexiones MCP pueden ser de dos tipos: remotas o locales. Las conexiones remotas se establecen entre agentes de IA y servidores MCP a través de Internet, mientras que las conexiones locales se producen dentro de la misma máquina, donde los clientes y servidores MCP son programas de software que se ejecutan de forma independiente pero en el mismo entorno.

El proceso de comunicación en una conexión MCP sigue tres fases principales:

- Inicialización: El cliente envía el primer mensaje, y en una breve serie de mensajes subsiguientes, el cliente y el servidor acuerdan las versiones del protocolo para asegurar la compatibilidad.

- Intercambio de Mensajes: Durante esta fase, se intercambian solicitudes, resultados y notificaciones, permitiendo la interacción continua entre el agente de IA y las herramientas externas.

- Terminación: Cualquiera de las partes, el cliente o el servidor, puede finalizar la conexión enviando un mensaje «close()».

Para reforzar la seguridad, es crucial que se realicen pasos adicionales de autenticación y autorización antes de estas tres fases de comunicación.

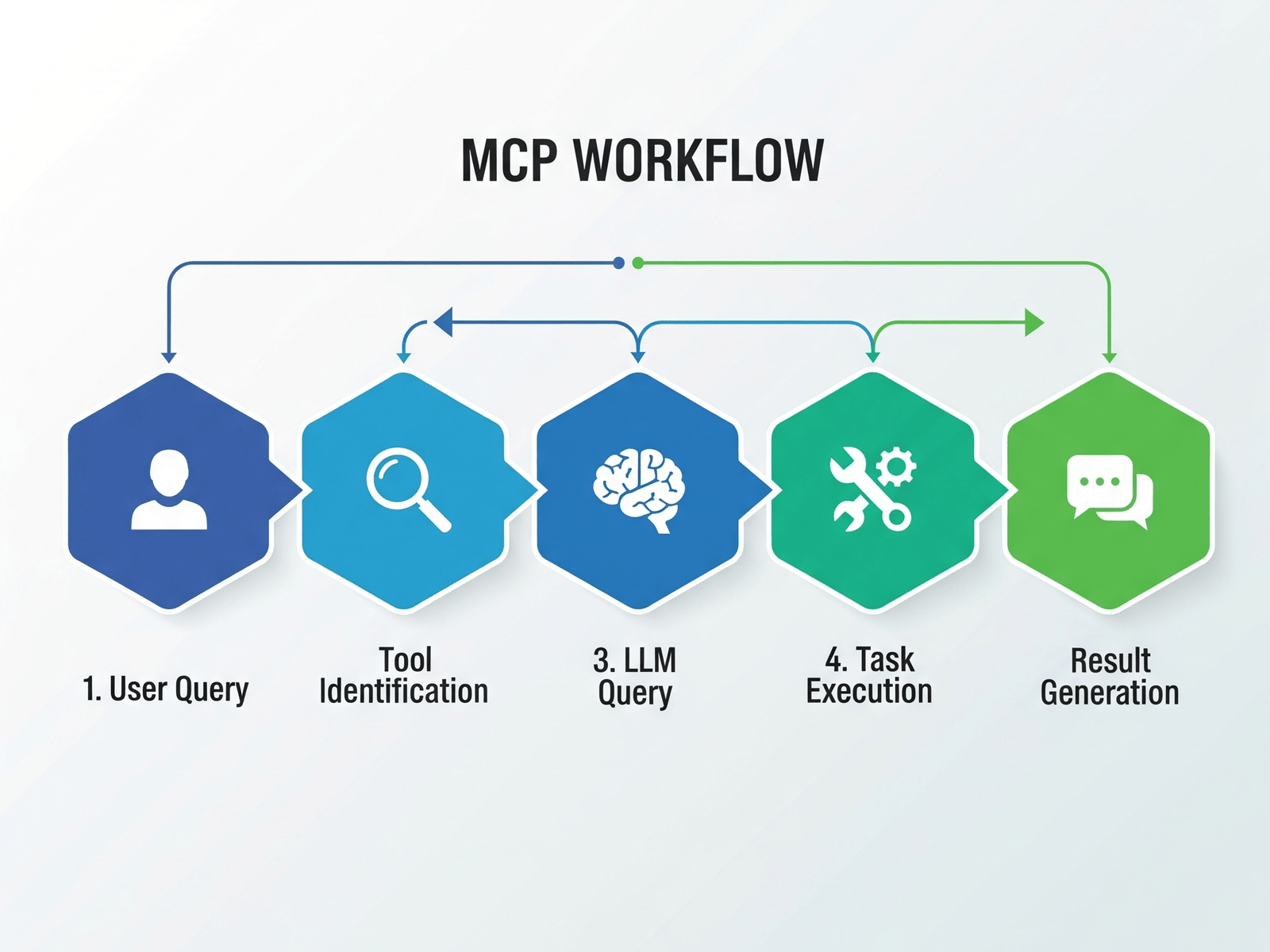

El flujo de trabajo general del MCP en la práctica es el siguiente:

- Consulta del Usuario: Un usuario interactúa con la aplicación host del MCP (por ejemplo, una aplicación de chat) y plantea una pregunta o una solicitud, como «¿Cuál es el pronóstico del tiempo en Madrid?» o «Genera una factura para el cliente X».

- Identificación de Herramientas: El host, a través de su cliente MCP, envía la consulta al servidor, que identifica las herramientas necesarias para responder a la solicitud.

- Consulta al LLM: El host se conecta a un LLM y le envía la pregunta junto con la lista de herramientas disponibles. El LLM analiza esta información y decide cuál o cuáles herramientas son las más adecuadas para resolver la consulta.

- Ejecución de Tareas: Una vez que el host sabe qué herramientas se necesitan, invoca al servidor o servidores MCP apropiados para ejecutar la tarea. Esto puede implicar consultar una base de datos, llamar a una API externa o ejecutar un fragmento de código.

- Generación de Resultados: El servidor envía los resultados de la ejecución de la tarea de vuelta al LLM, que luego integra esta información con su propio conocimiento para generar la respuesta final y relevante para el usuario.

Lo que hace que el MCP sea excepcionalmente flexible es su capacidad para abstraer las particularidades de las diferentes fuentes de datos. Puede conectarse a bases de datos relacionales, bases de datos NoSQL, APIs REST, APIs GraphQL e incluso archivos locales. Esta capacidad permite a los desarrolladores concentrarse en construir agentes de IA útiles y potentes sin tener que preocuparse por la tecnología subyacente de la fuente de datos, lo cual es particularmente beneficioso para aplicaciones como los asistentes de código que necesitan interactuar con una amplia variedad de información.

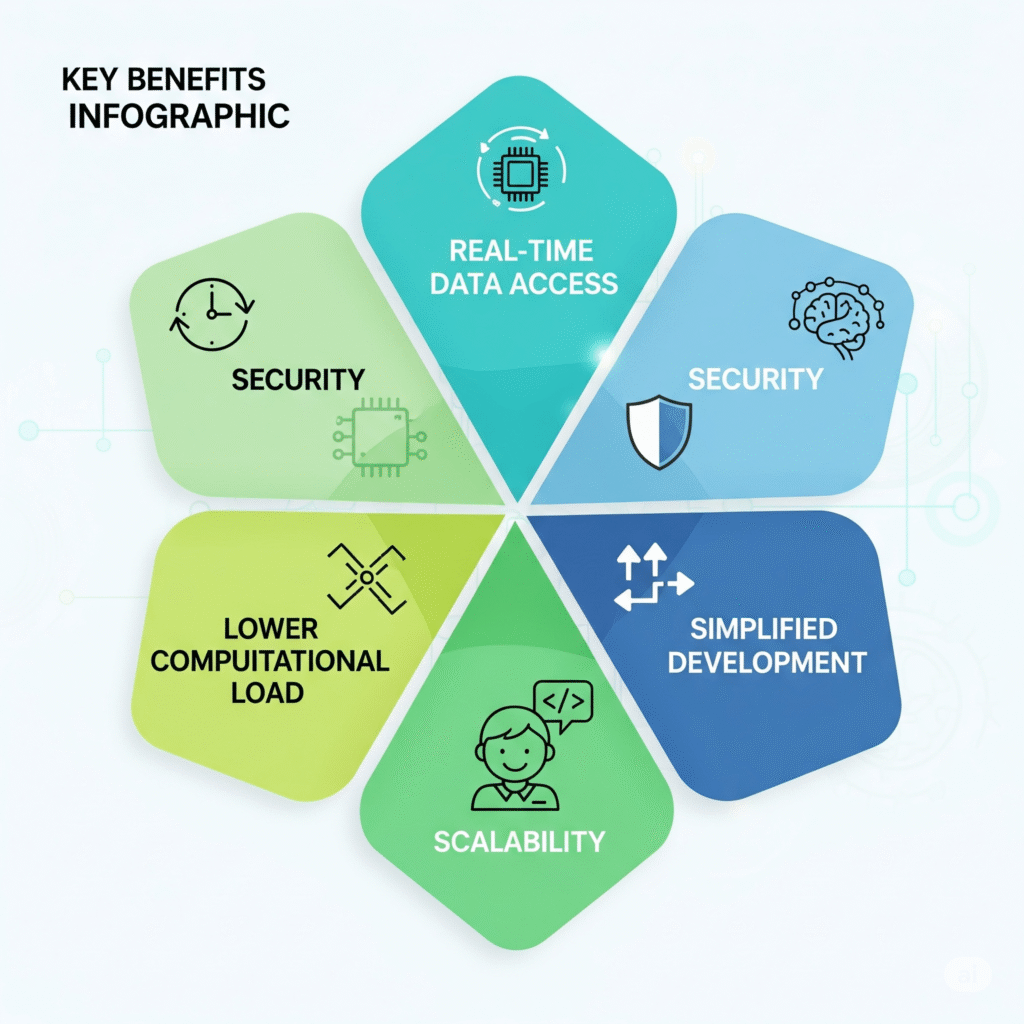

Beneficios Transformadores del MCP: Un Salto Cuántico para la IA

El Protocolo de Contexto de Modelo no es simplemente una evolución en la integración de la IA; representa un salto cualitativo que aborda problemas fundamentales y abre nuevas posibilidades para el desarrollo de sistemas inteligentes. Sus beneficios se extienden desde la eficiencia operativa hasta la seguridad y la adaptabilidad.

Acceso a Datos en Tiempo Real

Uno de los beneficios más significativos del MCP es su capacidad para proporcionar acceso a datos en tiempo real. A diferencia de los métodos tradicionales que a menudo dependen de conjuntos de datos precargados, indexados o en caché que pueden quedar obsoletos rápidamente, el MCP recupera la información directamente cuando se necesita. Esto asegura que los sistemas de IA siempre trabajen con la información más fresca y actualizada, minimizando el riesgo de respuestas incorrectas o desactualizadas. En entornos donde la información cambia constantemente, como los mercados financieros o los sistemas de monitoreo de IoT, esta capacidad es invaluable.

Seguridad y Cumplimiento Mejorados

El MCP mejora intrínsecamente la seguridad y el cumplimiento normativo al extraer datos solo cuando son necesarios y sin mantener copias innecesarias. Este enfoque reduce significativamente la exposición a posibles brechas de seguridad y riesgos de cumplimiento que surgen del almacenamiento de datos intermediarios. Es particularmente beneficioso para industrias que manejan información sensible, como la atención médica y las finanzas, donde la privacidad y la adhesión a regulaciones estrictas son de máxima prioridad. Al no retener datos más allá de lo necesario para la interacción, el MCP minimiza la superficie de ataque.

Menor Sobrecarga Computacional

Muchos sistemas de IA tradicionales utilizan técnicas como incrustaciones (embeddings) y bases de datos vectoriales para preprocesar grandes volúmenes de información, lo que requiere recursos computacionales significativos. El MCP reduce esta carga al permitir que los modelos soliciten solo los datos necesarios en tiempo real. Este enfoque bajo demanda disminuye los costos de computación y mejora el rendimiento general del sistema, haciendo que la operación de la IA sea más eficiente y escalable.

Escalabilidad y Adaptabilidad sin Esfuerzo Adicional

La escalabilidad es un desafío constante en el desarrollo de software, y las integraciones de IA no son una excepción. Los métodos tradicionales exigían la creación de conectores personalizados para cada nueva plataforma o servicio, lo que añadía una complejidad considerable al escalar. El MCP, al utilizar un protocolo estándar, permite a los modelos de IA conectarse con una amplia variedad de sistemas sin necesidad de un esfuerzo de desarrollo adicional por cada nueva integración. Esto facilita enormemente la escalabilidad en múltiples flujos de trabajo de IA. Además, el MCP ayuda a los modelos de IA a descubrir dinámicamente nuevas fuentes de datos y a adaptarse a entornos cambiantes, lo que permite que los sistemas de IA se mantengan receptivos a las necesidades en evolución sin una reconfiguración constante. Esta adaptabilidad es clave para la longevidad y utilidad de las aplicaciones de IA.

Simplificación del Desarrollo y Mantenimiento

Para los desarrolladores, el MCP representa una simplificación significativa. Ya no necesitan mantener conectores API separados para cada sistema externo. Esto no solo acelera el proceso de desarrollo inicial, sino que también reduce drásticamente las complejidades de mantenimiento. Las actualizaciones o cambios en las API de los servicios externos son menos propensos a «romper» las integraciones existentes, lo que se traduce en una mayor estabilidad y menos trabajo para los equipos de desarrollo.

Mayor Conciencia del Contexto

El MCP actúa como una capa de traducción universal entre las aplicaciones de IA y las herramientas externas, permitiendo que la IA acceda a un contexto más rico y relevante para sus conversaciones y acciones. Esta capacidad de integrar dinámicamente información de diversas fuentes permite a los agentes de IA mantener una conciencia contextual superior, lo que lleva a respuestas más precisas, relevantes y, en última instancia, a una experiencia de usuario mejorada.

En resumen, el MCP no es solo otra forma de conectar la IA con los datos; resuelve problemas reales asociados con los métodos de integración obsoletos. Al mejorar el rendimiento, la seguridad y la flexibilidad, hace que los sistemas de IA sean más capaces y fáciles de gestionar.

Casos de Uso y Aplicaciones del MCP en el Mundo Real

El MCP es particularmente útil en cualquier aplicación que dependa de información en tiempo real y la capacidad de actuar sobre ella:

Ejemplos de Servidores MCP

Los servidores MCP son los puntos de conexión que exponen funcionalidades específicas a las aplicaciones de IA. Se pueden clasificar en servidores de referencia, integraciones oficiales y servidores comunitarios:

- Servidores de Referencia: Mantenidos por los contribuidores del proyecto MCP, sirven como ejemplos de implementación de la funcionalidad central del protocolo.

- PostgreSQL: Permite la interacción con bases de datos PostgreSQL, específicamente la ejecución de consultas SQL de solo lectura. Esta limitación de solo lectura ilustra cómo las herramientas MCP pueden diseñarse con parámetros de seguridad específicos.

- Slack: Habilita a las aplicaciones de IA para leer y escribir mensajes en espacios de trabajo de Slack, añadir reacciones y recuperar el historial de canales, entre otras funciones. Esto demuestra el potencial del MCP para acceder a información de una amplia variedad de fuentes, incluyendo aplicaciones de mensajería populares.

- GitHub: Soporta una amplia gama de acciones, incluyendo la automatización de procesos (ej. push de código), la extracción o el análisis de datos, e incluso la construcción de aplicaciones basadas en IA. El servidor GitHub MCP actual sirve como un referente de cómo los asistentes de IA pueden interactuar con APIs externas.

- Integraciones Oficiales del MCP: Son servidores con soporte oficial de las empresas propietarias de las herramientas, listos para producción.

- Stripe: Esta integración puede manejar casos de uso como la generación de facturas, la creación de clientes o la gestión de reembolsos a través de solicitudes en lenguaje natural. Su principal atractivo es el potencial para delegar las preocupaciones de pago a chatbots de atención al cliente.

- JetBrains: Permite a los desarrolladores aprovechar la asistencia de IA directamente dentro de los IDEs de JetBrains, proporcionando funcionalidades como la exploración de código, la configuración de puntos de interrupción y la ejecución de comandos de terminal mediante lenguaje natural.

- Apify: A través de sus más de 4.000 Apify Actors, habilita una amplia gama de funciones, incluyendo un navegador web RAG (Generación Aumentada por Recuperación), scraping de datos en múltiples plataformas y rastreo de contenido.

- Servidores Comunitarios del MCP: Desarrollados por entusiastas y contribuidores independientes, abordan una diversidad de necesidades.

- Discord: Similar a la integración de Slack, permite a los usuarios enviar y leer mensajes en esta popular aplicación de mensajería, con descubrimiento automático de servidores y canales.

- Docker: Facilita la interacción en lenguaje natural con Docker para gestionar contenedores, volúmenes e imágenes, abstractando la gestión de motores Docker locales y remotos en una interfaz más amigable.

- HubSpot: Esta integración con el CRM HubSpot permite a los usuarios listar y crear contactos, obtener interacciones recientes y gestionar empresas, proporcionando una forma sencilla de recuperar información para su uso con otras herramientas.

Ejemplos de Clientes MCP

La lista de aplicaciones que ya soportan integraciones MCP es extensa y sigue creciendo, lo que demuestra la rápida adopción del protocolo en el ecosistema de la IA. Algunos ejemplos notables incluyen:

- IDEs y Asistentes de Código: VS Code GitHub Copilot, JetBrains AI Assistant, Cursor, Continue, CodeGPT, Amazon Q IDE, Amp, Augment Code, Cline, Kilo Code, OpenSumi, TheiaAI/TheiaIDE, Windsurf Editor, Zed, Zencoder. Estas herramientas permiten a los desarrolladores aprovechar la IA para la exploración de código, la refactorización, la automatización de tareas y la interacción con sistemas de control de versiones.

- Aplicaciones de Chat y Asistentes Generales: ChatGPT, Claude.ai, Claude Desktop App, BoltAI, Chorus, ChatWise, LibreChat, LM Studio, MooPoint, TypingMind App, Witsy. Estos clientes extienden las capacidades conversacionales de los LLM, permitiéndoles acceder a información en tiempo real y realizar acciones a través de las herramientas MCP.

- Frameworks y Plataformas de Agentes: AgentAI, AgenticFlow, BeeAI Framework, Daydreams, fast-agent, FLUJO, Genkit, Goose, HyperAgent, Lutra, mcp-agent, MindPal, NVIDIA Agent Intelligence (AIQ) toolkit, SpinAI, Superinterface, Tambo, Tencent CloudBase AI DevKit. Estas herramientas facilitan la construcción, despliegue y gestión de agentes de IA complejos que aprovechan las capacidades del MCP.

- Herramientas de Productividad y Automatización: Postman (para testing de servidores MCP), Shortwave (cliente de email con MCP), Superjoin (extensión de Google Sheets), WhatsMCP (cliente de WhatsApp).

- Herramientas de Terminal: Amazon Q CLI, gptme, MCPOmni-Connect, oterm, Warp.

La diversidad de estos clientes, que abarcan desde entornos de desarrollo hasta aplicaciones de productividad y frameworks, subraya cómo el MCP está permeando diferentes capas del software, haciendo que la IA sea más útil y accesible en una variedad de contextos.

Aplicaciones Prácticas y Casos de Uso

El MCP es particularmente útil en cualquier aplicación que dependa de información en tiempo real y la capacidad de actuar sobre ella:

- Sistemas de Soporte Inteligentes: Los agentes de IA pueden acceder a sistemas de gestión de relaciones con clientes (CRM), tickets de soporte y bases de datos de preguntas frecuentes a través de una sola capa, mejorando la eficiencia y la precisión de las respuestas.

- Asistentes Financieros: Permiten agregar y analizar información de múltiples fuentes financieras, como bancos, tarjetas de crédito e inversiones, para proporcionar pronósticos impulsados por IA basados en los últimos datos del mercado.

- Refactorización y Asistencia de Código con IA: Los agentes de IA pueden conectarse a analizadores de código, perfiladores de rendimiento y herramientas de seguridad para ayudar a los desarrolladores a escribir, depurar y optimizar código de manera más eficiente.

- Análisis de IoT: Facilita la toma de decisiones instantánea basada en lecturas de sensores en vivo, lo que es crucial para la automatización industrial, ciudades inteligentes y dispositivos conectados.

- Ciberseguridad: Permite la detección y respuesta dinámica a amenazas, donde los sistemas de IA pueden acceder a registros de seguridad, bases de datos de vulnerabilidades y herramientas de respuesta para mitigar riesgos en tiempo real.

Estos ejemplos demuestran cómo el MCP está permitiendo a la IA trascender sus límites de entrenamiento, interactuar con el mundo exterior de manera significativa y ofrecer soluciones más inteligentes y automatizadas en una amplia gama de industrias.

Desafíos y Consideraciones de Seguridad del MCP

A pesar de sus prometedores beneficios, el Protocolo de Contexto de Modelo, como cualquier tecnología emergente, presenta una serie de desafíos y consideraciones de seguridad que requieren una atención cuidadosa para su implementación robusta y segura. La madurez actual del protocolo introduce riesgos para las organizaciones que despliegan soluciones basadas en MCP sin medidas de seguridad adicionales.

Preocupaciones de Seguridad Significativas

La capacidad del MCP para otorgar a los LLM acceso a sistemas externos introduce vulnerabilidades potenciales que deben ser consideradas con cautela en entornos empresariales. Las principales preocupaciones incluyen:

- Actores Maliciosos:

- Inyección de Prompt: Instrucciones maliciosas incrustadas en las entradas del usuario o descripciones de herramientas podrían llevar a acciones no deseadas por parte del LLM. Por ejemplo, un usuario podría enviar un prompt que, aunque parezca inofensivo, esté diseñado para filtrar información privada o manipular las acciones del agente de IA. Por ello, las acciones realizadas por los servidores MCP deberían ser siempre confirmadas por los usuarios o restringidas a un nivel de riesgo aceptable.

- Envenenamiento de Herramientas y Rug Pulls: Los atacantes pueden modificar las definiciones de las herramientas o realizar «rug pulls» (similar al envenenamiento pero ocurre después de la instalación). Un servidor MCP malicioso podría parecer seguro inicialmente, pero sus herramientas podrían ser modificadas en una actualización futura para realizar acciones dañinas, como recopilar información confidencial.

- Sombreado de Herramientas: Un servidor malicioso podría crear una herramienta con el mismo nombre que una herramienta legítima de otro servidor para interceptar llamadas, desviando las acciones del LLM.

- Exfiltración de Datos: La exfiltración de datos a través de herramientas comprometidas y la ejecución remota de código facilitada por servidores MCP mal implementados también representan una amenaza. El MCP, por sí mismo, carece de mecanismos inherentes de aplicación de seguridad, dependiendo en gran medida de implementaciones externas para la autenticación y autorización, que inicialmente no estaban bien definidas dentro del protocolo. Los servidores MCP que solicitan permisos excesivos pueden escalar el riesgo si un servidor es violado.

- Gestión de Identidad: Determinar una gestión de identidad clara —si las solicitudes se originan del usuario final, el agente de IA o una cuenta de sistema compartida— sigue siendo un área que necesita una definición más precisa. Esta ambigüedad plantea riesgos para las organizaciones que implementan soluciones basadas en MCP, particularmente en lo que respecta a la auditoría, la rendición de cuentas y el control de acceso. Sin una forma estandarizada de atribuir acciones, puede ser difícil rastrear quién o qué inició una operación específica.

Riesgos Específicos y Enfoques de Mitigación

Investigadores de seguridad han identificado varios riesgos específicos y han propuesto enfoques para mitigarlos:

- Autenticación y Autorización: Existe el riesgo de un problema de «diputado confundido» cuando un servidor MCP realiza una acción activada por la solicitud de un usuario. Idealmente, el servidor MCP debería ejecutar esta acción en nombre del usuario y con su permiso. Sin embargo, esto no está garantizado y depende de la implementación del servidor MCP. Si no se implementa correctamente, un usuario podría obtener acceso a recursos que no deberían estar disponibles para él, pero que sí lo están para el servidor MCP, violando el principio de menor privilegio. Aunque el MCP define la autorización utilizando OAuth, la comunidad ha señalado que la especificación actual incluye detalles de implementación que entran en conflicto con las prácticas empresariales modernas. Se están realizando esfuerzos dentro de la comunidad para mejorar y actualizar la especificación de autorización y abordar esta discrepancia.

- Riesgos de la Cadena de Suministro: Los servidores MCP están compuestos por código ejecutable, por lo que los usuarios solo deben emplear servidores MCP en los que confíen. Los componentes del MCP deben ser firmados por el desarrollador para asegurar su integridad. Además, es fundamental construir componentes MCP en entornos que implementen las mejores prácticas de seguridad, como las pruebas de seguridad de aplicaciones estáticas (SAST) y el análisis de composición de software (SCA) para identificar y corregir vulnerabilidades conocidas en las dependencias. Si un servidor MCP se ofrece como servicio en la nube, debe implementar la verificación criptográfica del servidor para que los clientes puedan verificar su autenticidad. Para reducir el riesgo de que los atacantes modifiquen el código fuente, los desarrolladores y usuarios deben verificar la integridad de todas las dependencias y escanearlas en busca de malware.

- Ejecución de Comandos No Autorizados: Los servidores MCP locales pueden ejecutar cualquier código. Dependiendo de cómo el cliente MCP pase la información al servidor MCP y de cómo se implemente el servidor, la funcionalidad de ejecución de comandos puede ser vulnerable a inyecciones de comandos. Siempre se debe verificar qué comandos se ejecutarán y sanear los datos antes de usarlos como argumento para una función que ejecuta comandos. Adicionalmente, se recomienda ejecutar los servidores MCP locales en un entorno aislado (sandbox) para que solo puedan ejecutar y acceder a lo que se les permite explícitamente.

- Inyección de Herramientas: Existe la posibilidad de que alguien construya un servidor MCP malicioso. Un servidor así podría parecer seguro durante la instalación, pero sus herramientas podrían ser modificadas en una actualización futura para realizar acciones dañinas. También pueden usar nombres engañosos para las herramientas para que el LLM las seleccione para una tarea que debería ser realizada por herramientas legítimas. Para mitigar este riesgo, el software que permite a los usuarios instalar servidores MCP debería tener la capacidad de fijar la versión de los servidores MCP y notificar al usuario si se producen cambios en su código o composición después de la instalación.

- Muestreo (Sampling): Los servidores MCP maliciosos podrían intentar explotar la funcionalidad de muestreo, donde los servidores MCP pueden solicitar a los clientes MCP que utilicen un LLM para completar una solicitud. Si un servidor MCP necesita enviar una solicitud a un LLM, el muestreo permite que el cliente MCP realice la solicitud en nombre del servidor MCP, ya que el usuario tiene más control sobre el cliente MCP y ayuda a centralizar los costos. Los clientes MCP deben implementar controles como mostrar al usuario la solicitud de finalización, permitir modificarla o rechazarla, filtrar o modificar las finalizaciones, controlar qué modelo se utiliza, implementar límites de velocidad apropiados, controlar la exposición a costos e implementar tiempos de espera.

- Registro (Logging): Dado que los servidores MCP pueden ejecutar comandos sensibles, deben tener la capacidad de enviar registros o eventos a servidores de registro centralizados estándar o de registrarlos localmente. Esto permite la investigación de las acciones del sistema si ocurre o se sospecha un problema.

- Gestión de Vulnerabilidades: Los servidores MCP son código y, como cualquier otro software, pueden tener vulnerabilidades. Es fundamental incluirlos en el proceso estándar de gestión de vulnerabilidades de una organización, lo que implica actualizar los clientes y servidores MCP y sus dependencias a intervalos planificados, basándose en el apetito de riesgo de la organización.

Limitaciones de Diseño y Madurez del Ecosistema

Más allá de la seguridad, el MCP tiene tres áreas clave que requieren una mayor maduración en sus capacidades:

- Diseño de Protocolo con Estado (Stateful): La dependencia del protocolo en los Server-Sent Events (SSE) con estado puede crear complejidades significativas al integrarse con las API REST inherentemente sin estado, lo que requiere que los desarrolladores gestionen el estado externamente. Esto puede ser particularmente desafiante para los servidores MCP remotos debido a la latencia e inestabilidad de la red, lo que complica el equilibrio de carga y los esfuerzos de escalado horizontal. Mantener conexiones persistentes consume más recursos del servidor y puede dificultar la resiliencia general del sistema.

- Escalado de Contexto: Existe la preocupación de que múltiples conexiones MCP activas puedan consumir una cantidad significativa de tokens en la ventana de contexto del LLM. Esto puede afectar directamente el rendimiento de un LLM, ralentizando las respuestas y potencialmente obstaculizando su capacidad para mantener el enfoque y razonar eficazmente en interacciones prolongadas o complejas. Las ventanas de contexto grandes son intensivas en recursos, y gestionar su consumo en muchas conexiones concurrentes presenta un desafío notable para la eficiencia del LLM.

- Manejo de Errores: Aunque existen códigos de error básicos, el MCP aún no impone un estándar integral de manejo de errores, y su alcance actualmente se limita al descubrimiento e invocación, omitiendo aspectos cruciales como la gobernanza de herramientas, el versionado o la gestión del ciclo de vida. Esta falta de estandarización completa puede llevar a implementaciones inconsistentes y posibles desafíos de interoperabilidad.

Desafíos de Adopción e Inmadurez del Ecosistema

Como protocolo relativamente nuevo, el MCP enfrenta los desafíos inherentes a la adopción temprana y la madurez del ecosistema:

- Falta de Soporte Generalizado (Inicial): Actualmente, el MCP carece de un soporte generalizado en la industria por parte de todas las aplicaciones y herramientas. Muchas herramientas ampliamente utilizadas aún no han lanzado ofertas de servidores MCP, lo que limita la utilidad práctica inmediata del MCP para los equipos que buscan integrarse con sus pilas tecnológicas existentes en producción. Sin embargo, la creciente lista de clientes y servidores MCP, incluyendo el apoyo de actores importantes como GitHub y Microsoft, junto con OpenAI y Google, está mitigando rápidamente esta preocupación.

- Documentación y Comunidad (Inicial): La documentación completa ha sido deficiente en ciertas áreas, y la comunidad de desarrolladores es relativamente incipiente en comparación con métodos de integración más maduros. Esto puede significar menos soporte entre pares para aquellos que buscan aprovechar o construir con la tecnología MCP. No obstante, la rápida expansión de la comunidad y la creciente disponibilidad de recursos están abordando estas brechas.

- Riesgo de Obsolescencia y Fragmentación: La naturaleza evolutiva del estándar introduce un grado de incertidumbre. En el rápido panorama de la IA, siempre existe la posibilidad de que el protocolo pueda evolucionar tan drásticamente que el desarrollo anterior quede obsoleto, o que surja un protocolo completamente nuevo y competidor que gane dominio. Sin embargo, el hecho de que Anthropic mantenga la naturaleza de código abierto del protocolo y la expansión del Comité Directivo del MCP para incluir a actores importantes como GitHub, Microsoft, y OpenAI, y a los principales miembros del comité técnico de Google, mitigan significativamente estas preocupaciones, apuntando hacia un futuro más colaborativo y estandarizado y reduciendo el riesgo de dependencia de un solo proveedor.

Conclusión: El Futuro Conectado de la IA

El Protocolo de Contexto de Modelo (MCP) emerge como un pilar fundamental en la evolución de la inteligencia artificial, marcando un antes y un después en la forma en que los sistemas de IA interactúan con el mundo real. Al proporcionar un estándar abierto y unificado, el MCP aborda una de las limitaciones más críticas de los Modelos de Lenguaje Grandes: su incapacidad inherente para operar más allá de sus datos de entrenamiento estáticos. Se ha establecido como un «puerto universal» que permite a la IA no solo procesar información, sino también descubrir herramientas, ejecutar acciones y acceder a datos en tiempo real de manera fluida y estandarizada.

Los beneficios que el MCP aporta son transformadores. Facilita un acceso a datos siempre actualizados, lo que es crucial para la relevancia y precisión de las respuestas de la IA. Mejora la seguridad y el cumplimiento al reducir la necesidad de almacenar datos intermediarios y al permitir la extracción de información solo cuando es estrictamente necesaria. Además, disminuye la sobrecarga computacional, optimiza el rendimiento y, quizás lo más importante, simplifica drásticamente el desarrollo y mantenimiento de aplicaciones de IA, permitiendo una escalabilidad y adaptabilidad sin precedentes. Esta capacidad de conectar la IA a un vasto ecosistema de herramientas y servicios externos, desde bases de datos hasta sistemas de gestión de proyectos y plataformas de pago, está desbloqueando un sinfín de casos de uso innovadores en sectores como las finanzas, la ciberseguridad y la asistencia de código.

Si bien el camino del MCP no está exento de desafíos, particularmente en lo que respecta a la seguridad, la gestión de identidad y la maduración de su ecosistema, la activa participación de la comunidad y el compromiso de grandes actores de la industria como Anthropic, GitHub, Microsoft, OpenAI y Google en su desarrollo y estandarización son señales inequívocas de su potencial a largo plazo. Las preocupaciones sobre la inyección de prompts y herramientas, los riesgos en la cadena de suministro y la necesidad de una autenticación y autorización robustas están siendo abordadas activamente por la comunidad, lo que sugiere un futuro de mayor resiliencia y confianza.

En última instancia, el Protocolo MCP no es solo una especificación técnica; es un catalizador que acelera la transición hacia una inteligencia artificial verdaderamente agéntica, adaptable y profundamente integrada en nuestras vidas y sistemas. Su adopción generalizada promete una era en la que la IA no solo comprende y genera, sino que también actúa de manera autónoma y eficaz, transformando la forma en que interactuamos con la tecnología y el mundo que nos rodea.

Referencias del Artículo:

- https://www.f5.com/es_es/glossary/model-context-protocol

- https://en.wikipedia.org/wiki/Model_Context_Protocol

- https://www.reddit.com/r/learnmachinelearning/comments/1kjrht0/model_context_protocol_mcp_clearly_explained/

- https://www.descope.com/learn/post/mcp

- https://www.cloudflare.com/es-es/learning/ai/what-is-model-context-protocol-mcp/

- https://www.moveworks.com/us/en/resources/blog/model-context-protocol-mcp-explained

- https://daily.dev/blog/what-is-mcp-model-context-protocol

- https://medium.com/@tahirbalarabe2/what-is-model-context-protocol-mcp-architecture-overview-c75f20ba4498

- https://portkey.ai/blog/benefits-of-mcp-over-traditional-integration

- https://www.cdata.com/blog/navigating-the-hurdles-mcp-limitations

- https://www.redhat.com/en/blog/model-context-protocol-mcp-understanding-security-risks-and-controls

- https://modelcontextprotocol.io/clients

- https://www.jetbrains.com/ai/

- https://apify.com/

- https://openai.com/chatgpt

- https://claude.ai/

- https://cursor.sh/

- https://continue.dev/

- https://github.com/danny-avila/LibreChat

- https://lmstudio.ai/

- https://www.boltai.com/

- https://www.chorus.ai/

- https://github.com/AgentAI/AgentAI

- https://github.com/AgenticFlow/AgenticFlow

- https://genkit.dev/

- https://www.postman.com/

- https://shortwave.com/

- https://www.superjoin.ai/

- https://github.com/gptme/gptme

- https://www.warp.dev/

Comparte este contenido